Advogados destacam que punição dependerá da constatação de falhas sistêmicas na moderação. STF amplia a responsabilidade das plataformas digitais pelo que publicam

Redes sociais não serão responsabilizadas por todos os posts criminosos, mesmo depois de o Supremo Tribunal Federal (STF) determinar situações em que esses conteúdos devem ser derrubados sem ordem judicial, dizem especialistas ouvidos pelo g1.

Até então, o Marco Civil, que rege a internet no Brasil, só previa isso em casos de posts com cenas de cenas de nudez ou de atos sexuais de caráter privado, sem a autorização dos participantes.

Mas a mudança determinada pelo STF só valerá quando a Justiça entender que existiu falha sistêmica das plataformas, segundo advogados.

“O caso individual, a princípio, serve para lançar luz sobre o tema, mas a responsabilização só ocorre se for identificado um problema maior, recorrente”, disse Álvaro Palma, advogado constitucionalista e professor da FGV Direito Rio.

O que dizem as redes sociais sobre decisão do STF

O que o STF mudou em relação às redes

O julgamento no STF sobre as redes foi encerrado nesta quinta (26), mas os ministros já tinham formado maioria no último dia 11.

Além da conclusão dos votos, faltava que acertassem os detalhes sobre em quais casos se daria essa responsabilização das redes, o que também foi feito nesta quinta.

O Supremo definiu três formas de atuação das redes sociais contra posts ilegais, conforme o tipo de crime encontrado:

remoção proativa, sem necessidade de notificação/ordem judicial – para casos considerados graves, como discurso de ódio, racismo, pedofilia, pornografia infantil, incitação à violência, crimes contra a mulher, tráfico de pessoas e defesa de golpe de Estado;

remoção após ordem judicial – para crimes contra a honra (como calúnia, injúria e difamação)

remoção após notificação extrajudicial (pelo usuário ou advogados, por exemplo) – para “danos decorrentes de conteúdos gerados por terceiros em casos de crime ou atos ilícitos”, ou seja, para os demais crimes.

Quem decide se existe falha recorrente?

Segundo o STF, conteúdos como discurso de ódio, racismo, pedofilia, incitação à violência e defesa de golpe de Estado devem ser removidos pelas plataformas de forma proativa e imediata — mesmo sem notificação prévia ou decisão judicial.

A responsabilidade civil, no entanto, só se aplica quando houver uma falha sistêmica, segundo Carlos Affonso Souza, advogado e diretor do Instituto de Tecnologia e Sociedade do Rio (ITS).

Ele explica que não existe uma definição jurídica precisa do que é uma falha sistêmica, mas que, de forma geral, se refere a situações em que falhas recorrentes das plataformas permitem a disseminação massiva de conteúdos ilícitos, gerando impactos graves e coletivos à sociedade.

Para Affonso, essa decisão do Supremo faz sentido, até porque as plataformas não teriam capacidade de monitorar tudo que circula nelas, mesmo com a ajuda de programas específicos.

“Não existe no mundo um software capaz de identificar com 100% de precisão, por exemplo, um ato antidemocrático.”

No entanto, ele alerta que, até agora, não está definido quem decidirá se houve falha recorrente nas plataformas.

“O Supremo incorporou a ideia de risco sistêmico, que veio do PL das Fake News, mas não explicou quem decide se o risco é sistêmico: se será um juiz, o Ministério Público ou algum novo órgão”, afirmou.

O ‘meio termo’ que preocupa

Já o cenário em que as plataformas poderão ser responsabilizadas se não removerem o conteúdo ilegal após uma notificação extrajudicial pode levar a novos problemas, na visão de Affonso.

Isso porque, diferente dos casos graves, em que a remoção deve ser feita sem notificação, o STF não determinou quais crimes se enquadram nessa situação.

“Minha crítica é que, agora, praticamente todo o conteúdo ilícito foi jogado nessa prateleira. Isso pode levar à remoção excessiva de conteúdos lícitos, pois as plataformas vão preferir não correr riscos.”

Para Álvaro Palma, da FGV Direito Rio, a ideia de que possa haver remoções desnecessárias não se sustenta.

“Já existe controle. Hoje, ele é feito com base nos termos e condições de uso das plataformas. O que o Estado está dizendo agora é que esses mecanismos são insuficientes”, avalia.

Crimes contra a honra

Para crimes contra a honra (como calúnia, injúria e difamação), o STF manteve a necessidade de ordem judicial prévia para a remoção do conteúdo.

“Você se sentiu injuriado? Só depois que sair a decisão judicial — e se ela for descumprida — é que a plataforma poderá ser responsabilizada. Isso não mudou”, explica Palma.

Affonso concorda com a decisão do Supremo. “Se (esses crimes) entrassem na lógica da notificação extrajudicial, isso poderia reduzir a visibilidade de denúncias, o que seria negativo”, afirma.

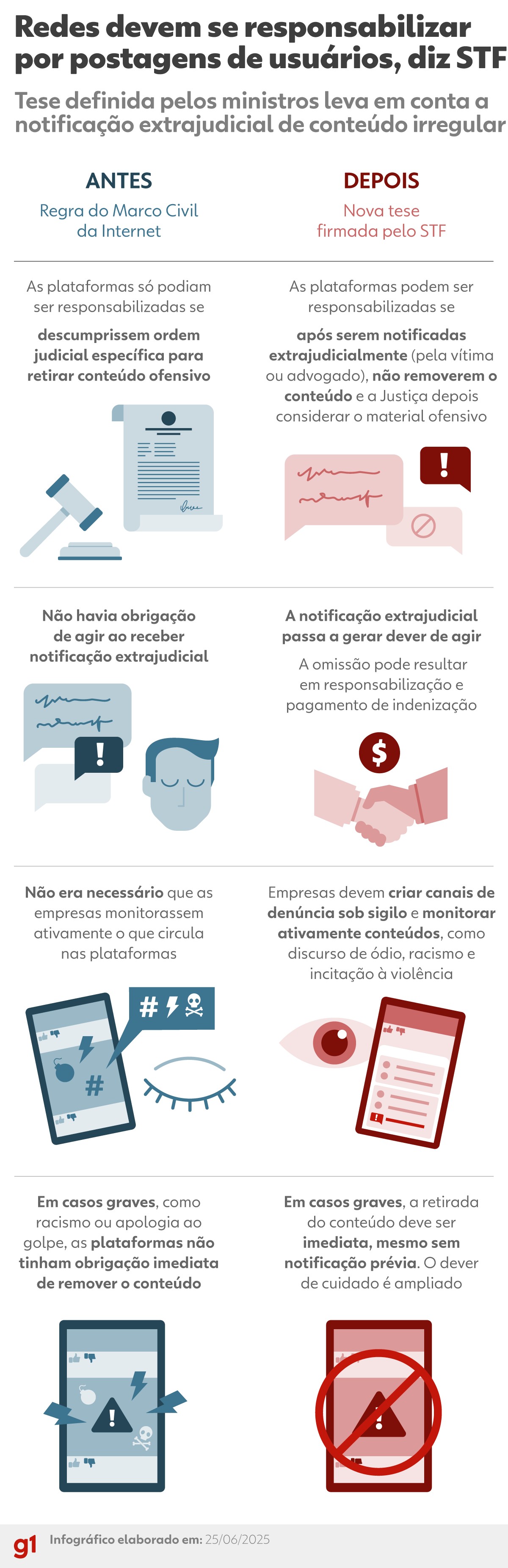

O que muda com a decisão do STF sobre responsabilidade das redes

Arte/g1

Plenário do STF durante julgamento sobre o Marco Civil da Internet

Ton Molina/STF

Veja mais:

O desgastante trabalho humano por trás do ChatGPT: ‘Não é tão emocionante quando descobrimos o que envolve’

Vazamento de dados expõe 16 bilhões de senhas; veja como se proteger